データサイエンスセミナー開催レポート Vol.1 シリコンバレーのDS

こちらの記事もご覧ください!

データサイエンスセミナー開催レポート Vol.1 シリコンバレーのDS

データサイエンスセミナー開催レポート Vol.2 シリコンバレーに学ぶ日本のデータサイエンスの現状と未来

データサイエンスセミナー開催レポート Vol.3 デジタルマーケティング領域におけるデータサイエンス活用法 ~デジタルマーケティング×データサイエンティスト~

アサインナビ主催で2017年8月に開催された「シリコンバレーに学ぶ、日本のデータサイエンスの現状と未来 ~これからのデータドリブンな時代に本当に必要なこと~」のセミナーレポート第1回目は、シリコンバレーでデータサイエンスを中心とした事業を展開するExploratory社を起業した、西田氏によるシリコンバレーのデータサイエンスの現状についてご紹介します。

■目次■

アサインナビが、データサイエンスセミナーを開催する理由

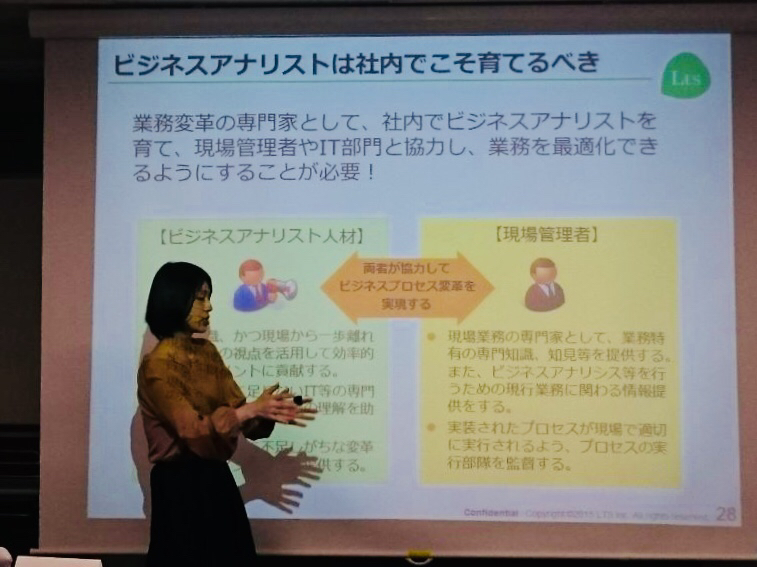

アサインナビでは、親会社である株式会社エル・ティー・エスと共同でデータサイエンティスト実践塾を開催するなど、データサイエンス人材の育成や企業のデータサイエンス活用を支援しています。

アサインナビ会員企業様の中からも、データサイエンティストを育成したい・データサイエンスについて学びたい・活用方法を知りたいといった声もあり、日本のデータサイエンスの普及に貢献する取り組みを、今後ますます強化していく予定です。

今回のセミナーは、その取り組みの一環として、シリコンバレーでデータサイエンスの第一線で活躍されているExploratory社西田氏を講師に迎え、2017年8月に開催したものです。

当日は、データサイエンスの歴史からシリコンバレーでのデータサイエンスの現状まで解説され、充実した内容となりました。

データサイエンスセミナーレポート

「シリコンバレーに学ぶ、日本のデータサイエンスの現状と未来 ~これからのデータドリブンな時代に本当に必要なこと~」のレポートをお届けします。

司会

ExploratoryInc.はシリコンバレーで西田さんが立ち上げた会社となります。データ分析のツールを開発して販売しており、今回のセミナーでは開発された製品紹介も兼ねてシリコンバレーのデータサイエンスの最前線の紹介と解説をしていただきます。よろしくお願いいたします。

以下西田氏

―まずは西田氏のお仕事について

紹介にあずかりました西田といいます。

普段はシリコンバレーの方にいるんですが、今週はこのセミナーと別の用事もあって日本に遊びにきました。Exploratoryという私の会社はスタートアップなんですけども1年半前位に立ち上げました。会社は西海岸のカリフォルニア・サンフランシスコの近くにあって僕もそこに住んでいます。

会社立ち上げの前は実はオラクルに勤めていました。

オラクルに1997年に入社してからその3年後の2000年にシリコンバレーに転勤となり、以来そのままアメリカに行ったままとなっています。オラクルは基本的にはデータベースの会社なのでデータ分析に特化した製品の開発をしていました。

しばらくして東海岸に行ってアメリカ各都市をいろいろまわりながらコンサルティングのような仕事をしていました。現地でいろいろな問題、カスタマーが抱えている課題を理解し始めたのでいちど西海岸に戻ってきてモバイルに特化した、ちょうど2008~9年だと思うんですけども、分析ツールの開発を始めました。

分析ツール開発の後に今度はクラウドベースの機械学習AIのプラットフォームを作っていこうと思うようになりました。その時に感じたのはデータ分析の世界は基本的なコアテクノロジー、最先端のテクノロジーはすべてオープンソースだということ。

Spark、TensorFlow、ディープランニング、機械学習といったもののすべてのアルゴリズムは全てオープンソースなんですよね。

なのでオラクルで最後の製品を作っていたときに1番辛かったのがオラクル自社のテクノロジーを使わなくちゃいけなかったことです。開発した製品を出したところでお客さんたちはもっと良いオープンソースのテクノロジーを使うことができること、そういった環境で戦っていかなければいけないことを踏まえて、私の提供するバリューとは何だろうと思うようになったんです。

オラクルに入社した20年前はオラクルにいることで最先端のテクノロジーを使えると言うメリットがあったけれど、会社を出ることにはオープンソーステクノロジーの発展に伴ってオラクルにいることが逆にデメリットになっていたんです。

―西田氏のデータサイエンスへの思い

オープンソースの世界はカオス、まさにすごい量のテクノロジーがあってまとまったコミュニティはあってないようなものなんです。

それをまとめてキュレートして普通の人でも使えるようにしていく事に価値があるのかなと思いExploratoryを立ち上げました。

オープンソースの世界と言う事はプログラミングの世界ですのでプログラミングができないと最先端のテクノロジーにアクセスできないんですけども、どんな人でも最先端のイノベーションにアクセスできるようにする社会を作ることが僕たちのミッションだと考えたんです。

―データサイエンスの歴史

今日のトピックとしてデータサイエンスというものがありますが、今この業界はすごく面白くて、いろんな言葉が飛び交っているんです。

AIだとか機械学習だとかディープランニングとかAlpha Goだとか、なんだかよくわからないような状態になっています。

ちょっとつまらなくなってしまうんですが、基本に帰るとデータサイエンスとは「数学だとか統計学だとかそういった数式であるだとかアルゴリズムを使ってデータの中からパターンを発見すること、それによって将来のビジネスパフォーマンスの予測をしたり、人間の目もしくは勘だとか経験からは知ることができなかった情報をインサイトとして得て、自分たちの目的達成の確率を最大化すること」となるのかなと曖昧に思っています。

データベースって、オラクルだったりマイクロソフトだったりすると思うんですけども、そこにあるデータにSQLでアクセスしてそれをUIから使えるようにしたものをBIというんですが、私たちは日頃その上にレポーティングだったりダッシュボードを挟んでデータを理解しているわけです。ほとんどの人にとってはそこからさらにExcelに抽出して、Excel上で分析するのが一般的な使い方だと思っています。

さらにアドバンストアナリティックスと呼ばれるものになるとSASだとかSPSSだとかの統計ソフトウェアがあって、それはSQLでアクセスしたデータに対して機械学習、統計のアルゴリズムをかけていきます。それも最終的には帳票にしてExcelにするというような形をとっています。

こういうのって実はそんなに新しくなくて結構前からあるものなんです。機械学習と言う言葉も今に始まった言葉ではなくてそういったものは昔からありました。

僕たちは第1の波と言っているんですけども、SASだとかSPSSに代表されるような形でアルゴリズムが使えるようになったのが70年代からです。何が波だったかと言うとお金を払ってソフトウェアパッケージを入手すればそのパッケージに含まれるアルゴリズムにアクセスできると言うところがポイントでした。それまでは自分たちで1から作らなければいけませんでしたからね。

ところが、データがすごい勢いで2000年ぐらいから増えてきました。いわゆるビックデータの時代だとかインターネット、モバイルの時代だとか最近だと、IoTとかありますけど、データがどんどん増えていっていることに対して対処していかなければならない状況になってきました。

そんな状況に対してオープンソースのコミュニティーがどんどん答えていくわけです。

コミュニティーの中にはGoogleや Facebookなどの先進企業の社員、個人もいれば大学の教員もいるわけですが、その人たちが新しい問題に対応しようっていうことで新しいアルゴリズムを作ったり既存のテクノロジーを発展させていったりしているわけです。

―データサイエンスとオープンソース

結局アナログの世界にあったものがすべてデジタル化されていくわけです。

例えばマーケティングの業界では昔からある新聞だとかラジオ、テレビ媒体ではなく、今ではウェブ・モバイル媒体での広告に移ってきています。

そこに広告を出すと、取得できるデータ量が多く、すべてのアクセスが読み取れるわけですから。

爆発的に増えるデータ量に関しては人によっては90%のデータはこの2年の間に作られたといいますけれども今日同じようなステートメントをするならばこの6ヵ月の間に作られたデータがすべてのデータの90%を占めると言っても過言ではないと思います。

この期間は情報のIT化の流れで今後どんどん短くなっていくと思います。このような状況にどうチャレンジするかというところが課題だと思います。

データ量の爆発的増加を受けて、それに対応するように作られたオープンソースのアルゴリズムって、オープンソースでいうとLinuxってみなさんご存知だと思うんですけども、出てきた当初のバリュープロポジション(価値)はフリー(無料)であることだったわけです。品質が悪くてもタダだからいいじゃないかという感じだったんですけれども、これもオープンソースが次第にキャッチアップしてできることが増えてきました。

データベースの世界でも同じことが起きてオラクルとMySQLにも同じことが言えます。

アルゴリズムでも同じことが起きていて、無料という点ではなく、むしろできることがあまりにもそちらの方が多い、さらにクオリティーがそちらの方が高い、スピードが早い、扱うことができるデータのサイズがでかいと言う風にオープンソースのアルゴリズムがなっていってるというのが現状です。

ビックデータ、SQLでストラクチャーされてないきれいになっていないデータからデータを取ってくる必要が出てきたんです。

その方がバリューが取り出せるからなんですけれども、それとデータっていうのは汚い状態なのでそれをきれいにしていてく作業が発生するんです。

BIを知っている人はDTLだとかデータウェアハウスでやってたんじゃないのと思うんですけども、まさにそのことです。

それがリレーションデータベースのデータじゃなくて外にある例えばログデータとかジェイソンのファイルだとかAPIのデータだとかそういうものに対してもできるようになってくると思うんですけれども、 最終的にはそこにいろいろな機械学習やAIを通して価値を抽出していこうと言う考えがあります。

―シリコンバレーのデータサイエンティストとは

シリコンバレーでデータサイエンスしている人達というのはどのようにしているんでしょうかと言う話になるんですけれども、基本的にはエンジニアもしくはハッカーと呼ばれる人が会社を始めるわけです。新しいテクノロジーを自分たちで作るもしくはそのテクノロジーを使って新たなプロダクト、サービスを作るという流れになります。ですのでその人たちは会社の比率としては、スタートアップとしては最低5人からの規模感になるのですが、大体プログラマー・ハッカーが全体の大部分を占めることになります。

Googleみたいなスタートアップとは呼べない会社でも6割位がプログラミングできるわけです。

オープンソーステクノロジーはたくさんあってRとかPythonとかであればすぐに手を出すことができるわけです。会社の半分以上の人たちはオープンソースのベネフィットをすぐに体感できる人たちです。その人たちがデータサイエンティストになっている形が結構多い。データサイエンスって言うと結構統計的な部分が大きいと思いますし統計やってた人たち、昔からSASとかSPSSだとかそういうバックグラウンドを持った人、がデータサイエンティストになるのが1つの流れだと思います。ただそれ以上に新しいオープンソースのテクノロジーを使って何かやり始めているうちに気づいたらデータサイエンティストなってましたって言う人たちが結構多いんです。

つまりデータサイエンティストって結構大学行ってなくても誰でもなれる、特別なトレーニングをしなくてもやりながらなれるって言うのが現状なんです。なんでなれるかって言うと、まだまだ新しいし需要がたくさんあるから。そこで資格認定・サーティフィケーションなんてやってる場合じゃなくて、とにかく出来るなら来てよっていうそういう感じなんです。それが今僕らが言ってる第二の波と言う部分ですね。

まとめると2000年位からインターネットに乗ってどんどんとデータが多くなっていった。さらにオープンソースの発展によって無料のソリューションが生まれるようになり、それらオープンソースのコミュニティーによる開発スピードの速さに一企業が太刀打ちできなくなってきたということです。誰でも持っているアルゴリズムを使って、その上に価値を作っていくことが重要になってきたんです。

―シリコンバレーでのデータサイエンスの状況

シリコンバレーの話になるんですが、地図で見ると上の方がサンフランシスコで下の方がサンホゼです。昔だったら下のほうのサンホゼあたりだけがシリコンバレーって言われてたんですけども、最近ではサンフランシスコの方でもUber、AirBNB、Dropbox、あとはTwitterとかが生まれています。

誰がシリコンバレーでデータサイエンスをしているかというと、基本的に全員やっています。

FacebookやGoogleなどの大企業はもちろん、大学だったりだとか、後は公開前のスタートアップの企業とかですね。

で、こういう人たちってどうやって分析してるかというと、基本的にどの企業でも製品もしくはサービスを開発している部門があって、何を開発するのかって言うのをマネージするプロダクトマネジメントっていうのがあって、それからIT、その製品だったりとかもしくはサービスって言うのを提供するためのインフラストラクチャーを作る人たち、がいるわけです。

それからカスタマーサクセスって最近は言ったりしますけれどもいわゆるカスタマーサポートとしてオンボーディングをやったり何か問題発生時にそれを解決に導く人達、そしてマーケティングとかファイナンスとかそういったどこの会社にもあるような部門で分析が行われています。

その中でいろんな手法をとりながら分析しているんです。

製品・サービス開発に関しては分析手法自体が作っているもの自体でもあるわけですよね。例えばレコメンデーションエンジンを作っている人たちは自分たちのサービスの1つとして作っていたりとかするんですね。

プロダクトマネジメントの文脈では開発のスケジュールをどうやって予測していくか、効率化していくかをデータサイエンスの手法を使いながら探っています。

つまり開発プロセスをどんどんと効率化していくわけです。

コード作成の文脈では、書いているコードを分析することによって間違いが起きやすいようなコードを抽出するだとか、そういうことにデータ分析を使っています。

後はプロダクトデザインの文脈では、A/Bテスト結果の評価をおこなったり、アンケート結果の評価と製品へのフィードバックに分析手法を応用したりだとか、カスタマーがサービスを使い続ける仕組みをどうやって作っていくかをデータ分析を使っておこなっています。

マーケティングなんかでも、これは日本でもすごく想像しやすいのかなと思うんですけども、キャンペーンをするときのリターンと投資、つまりどれくらい投資効果があるのかをキャンペーンをする前に予測したりとか、キャンペーンを始めて何が自分たちのゴール達成に寄与したのかを理解するのに効果的だったりします。

―データ先進企業におけるデータサイエンスの具体例

具体的な例でいくと、Facebookってすごいデータ先進企業で自分たちの製品も作るし自分たちの会社をマネージするのにデータサイエンスの手法を使って効率化させていく企業であるわけなんですけれども、彼らが1つやってるのが時系列予測なんですね。

これの新しいアルゴリズムを作って今年2017年の2月位からオープンソースとして公開してるわけです。これって統計を知らない人でもかなりクオリティーの高いモデルを作って時系列のデータを予測することができるものなんです。

それで彼らが使い始めてるのはFacebook.comにどれくらいのアクセスが来るだとかいろんなサービスに対してどれだけの需要があってどれだけのサーバーを用意しなければいけないのか、そのためにサポートの人をどれだけ用意しなければいけないとかだったりだとに使っています。

ポイントはやはりオープンソースにしてコミュニティーと一緒に改善していこうって言う形にしていることです。

Twitterの例で言うと、異常時検出って言うモデルがあって、時系列のデータで見たときに例えばサイトに爆発的なアクセスがあったりするわけです。

それに対してなぜ上がるのかってことが知りたいわけなんですけども、変なアクセスかアタッカーに攻撃されてるかもしれないし、逆に何かが流行ってるかもしれないわけですが、トレンドって言ったりするんですけども、それをアルゴリズムに検出させてオートマティックに出力させています。

たとえばトレンドデータとどこのページから来てるのかというリファラルデータと合わせることによって、世界中のどの国のどのページで何が盛り上がってるのかってことがわかるんです。これからキャンペーンをやるときにターゲットを絞りやすいのでそういうのを見ながら彼らはやっているわけです。

ただ現実の世界だと難しくて、データを見てなんとなくトレンドが見えていても結論を出しにくいということが多々あるわけです。

A/Bテストはやったことある人なら分かると思うんですけども。

後に統計とかデータサイエンスの手法を使って検証していこうって言う流れになるんですけども、Uberのデータサイエンティストが作ったのが「ベイズ確率ABテスト」と言うものです。

AがBに比べてどれくらいの%分良いのかっていうのが可視的にわかるようにしたものなんですけれども、これって結構大きなことなんです。

これがあることによって、ビジネス側の担当者、マーケティングもしくはプロダクトマネージャーの人、会社の経営層と話をするときに統計の理論を理解していなくても直感的になにがどの程度良いのかがわかるって言う部分がすばらしいと思っています。

最後に僕が名前を付けたんですが、A-Ha Moment分析っていうのがあって、これは製品とかサービスとかを使っていて「ああこれだからこの製品すごいんだ」と思う時ってあると思うんですけれど、何が要因になっているのか、またはどの機能が、もしくはどういったアクションをとるとそのユーザがA-HAてことに気づいてくれて使い続けてくれるのかっていうのをデータで読み取るための分析手法なんです。

例を出すとFacebookでよく言われているのが10日の内に7人の友達を登録すると良さがわかってきて、良さがわかると止められなくなってしまうと言われています。

そういうのがそれぞれの製品やサービスに実はあるんです。A-HA(ああ、それね!)ってやつです。

この結果がどう生かせるかというと、例えばフレンドリクエストを5回した人がいいだとか、もしくはこのボタンを押した人がユーザーとして残っているってことが分かったのであれば、それをみんなに気づいてもらうためにチュートリアルを書き換えるとか、ヘルプを用意するだとか、プロモーションとかビデオを作るとかっていうそういうことをしていけるわけです。

―データの見方について

ログデータをみるとわかるんですが、データベースとしてSQLやるときれいな形になるんですけども、ただそうじゃないデータってのはたくさんあって、この非整合データから分析できるかどうかでその後に作れるバリューって全然違うんです。

例えばログデータのレコードを見てみると最初にIPアドレス、この次に日にち、そしてどういうURLが叩かれたステータスがどうだったかってのが入っていたりするんですけども、このIPアドレスってロケーションが取れるんですよね。どこに住んでるとか。時間と日にちからは曜日がわかり、それが平日なのか週末なのかという情報が取れるわけです。

さらにURLをIPアドレスと掛け合わせて比べることによってユーザっていうのを特定できます。

名前はわからないかもしれないんですけども、同じユーザなのかっていうところがわかるわけです。

そういうことをしながらどんどんとデータを作って行くのがデータサイエンティストの醍醐味だと思っています。

データサイエンティストの仕事っていうのは「質問」が大体最初あるわけです。

質問もしくは課題であったりだとかがあって、その質問をデータで解決できるのかどうかっていうところまで落とし込みます。とってきたデータは整理されていないのでさっきみたいな感じでそれを加工するだとかで、データにエンリッチするとか言ったりするんですが、データの価値を高めることができるわけです。今度はそれを可視化していって人間の目で直感的にわかるような形にするわけです。

そこでこの質問に答えられる場合もありますが、データの量が多ければ多いほど人間の目では追い切れないような隠された原因があったり、折れ線グラフにしても線を500個並べてもよくわかんないだとかがあるわけです。そういうのは機械が得意なのでアルゴリズムで処理をして、わかりやすいものに返してくれるわけです。

これをデータエクスプロレーションと言うんですけれども、いろいろ見ながら試しながらインサイトをとっていくと言う手法です。得られたインサイトはわかりやすい形で伝えなければ次のアクションにつながらないので、最後にどうやって伝えるのか、伝えるためにデータをどうのように表現するのかっていうのはある意味データサイエンティストにとって1番重要なスキルだと思っています。

シリコンバレーではオープンソースのテクノロジーを使いながらこういったことをやっているんですけれども、そうじゃない普通の会社では今まで通りのExcelを使ったり、tableauたいなBIのツールを使ったりしているわけです。

前者との差はどんどんとついて行きます。

―データサイエンスに必要なスキル

データサイエンスに要求されるスキルと言うと「プログラミング・ハッキング」、「統計学」、そして「ビジネスの知識もしくは経験」、これら3つがうまく重なるとデータサイエンスの理想像となると思っています。

シリコンバレーでは結構「プログラミング・ハッキング」の方によっちゃっている部分があって、ただ私が考えるあるべき形は、ビジネスの知識・経験がある人が主体となってオープンソースアルゴリズムにアクセスし、それをプログラミングを勉強せずにUIで操作する、そしてGoogleやFacebook、TwitterやUberが使っているアルゴリズムと同じものにアクセスすることによって同じように分析をおこなうことだと思っています。

そうすることによってビジネスのことを理解している人たちが主導権を取り返すことができるわけです。

そういった世界っていうのが私とExploratoryが目指していることです。

※この後西田氏よりExploratoryの仕組み、UIの説明、データ分析の実演がされました。

データ分析ソリューション Exploratory の詳細はコチラをご覧ください。

データサイエンスについては、データサイエンティストとは?スキルの習得法は?や、データサイエンティスト実践塾の様子も合わせて参考にしてみて下さい。